La compañía de inteligencia artificial OpenAI ha anunciado cambios significativos en un acuerdo de colaboración con el Departamento de Defensa de los Estados Unidos, tras enfrentar una ola de críticas de empleados, expertos en ética y grupos de la sociedad civil. El acuerdo, inicialmente revelado a principios de mes, involucraba el uso de herramientas de OpenAI para tareas de ciberseguridad y análisis de datos en el Pentágono. La noticia desató un intenso debate sobre los límites éticos de la IA y el papel de las empresas tecnológicas en asuntos militares, llevando a la compañía a revisar los términos de la colaboración.

El contexto de esta polémica se remonta a los principios fundacionales de OpenAI, que originalmente se comprometió a desarrollar inteligencia artificial general (AGI) de manera segura y beneficiosa para la humanidad, con salvaguardas explícitas contra usos que pudieran causar daño o permitir "armamento autónomo". El acuerdo inicial con el ejército estadounidense, aunque limitado a áreas no letales como la defensa cibernética y la optimización logística, fue percibido por muchos como un alejamiento peligroso de esos principios. Críticos argumentaron que incluso usos 'no letales' en un contexto militar podrían normalizar la relación entre IA y guerra, abriendo la puerta a aplicaciones más controvertidas en el futuro.

Datos relevantes indican que el gasto del Departamento de Defensa de EE.UU. en IA y aprendizaje automático ha crecido exponencialmente en los últimos años, con un presupuesto solicitado de miles de millones de dólares para 2024. En este ecosistema, OpenAI, con sus modelos de lenguaje avanzados como GPT-4, representa un activo estratégico. Sin embargo, la empresa ha mantenido una política de uso que prohíbe explícitamente actividades con alto riesgo de daño físico, incluido el desarrollo de armas. La ambigüedad del acuerdo militar puso esta política bajo escrutinio.

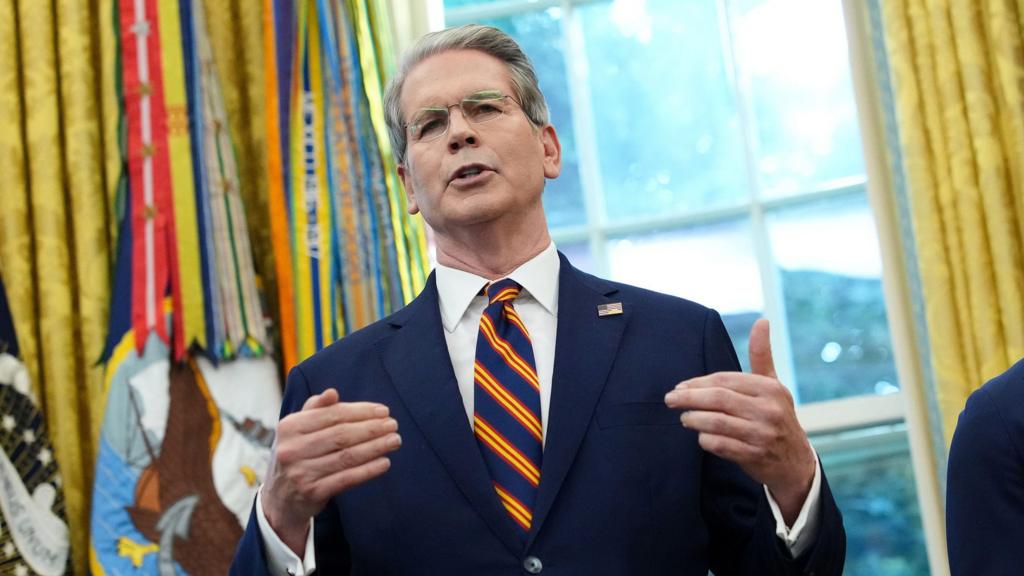

En declaraciones a la prensa, un portavoz de OpenAI afirmó: 'Escuchamos las preocupaciones expresadas por nuestra comunidad y socios externos. Si bien creemos en el potencial de la IA para mejorar la seguridad nacional en áreas como la defensa contra ciberataques, debemos asegurarnos de que cualquier colaboración se alinee de manera inequívoca y transparente con nuestro compromiso de seguridad y beneficio. Por ello, hemos revisado el acuerdo para incluir límites más estrictos, auditorías externas y una cláusula de terminación si se identifica cualquier desviación de nuestros estándares éticos'.

El impacto de esta decisión es multifacético. Por un lado, calma temporalmente la disidencia interna y externa, preservando la imagen de OpenAI como una empresa con conciencia ética. Por otro, plantea preguntas más amplias sobre la viabilidad de mantener barreras absolutas en un sector donde la tecnología dual (civil y militar) es la norma. Competidores como Google y Microsoft también han enfrentado dilemas similares con proyectos militares, como el controvertido Proyecto Maven de Google, lo que sugiere que esta no será la última confrontación entre la industria de la IA y su conciencia.

En conclusión, el replanteamiento de OpenAI sobre su colaboración con el ejército de EE.UU. subraya la tensión permanente entre la innovación tecnológica, los imperativos comerciales y la responsabilidad ética. Si bien la modificación del acuerdo representa una victoria para los defensores de una IA responsable, también revela la presión constante que ejercen los grandes contratos gubernamentales sobre las startups tecnológicas. El episodio sirve como un recordatorio crucial de que, en la era de la IA, los marcos de gobernanza y supervisión deben evolucionar al mismo ritmo que las capacidades técnicas, requiriendo un diálogo continuo y transparente entre empresas, gobiernos y la sociedad civil para navegar este territorio inexplorado.