A empresa de inteligência artificial OpenAI anunciou mudanças significativas em um acordo de colaboração com o Departamento de Defesa dos Estados Unidos, após enfrentar uma onda de críticas de funcionários, especialistas em ética e grupos da sociedade civil. O acordo, inicialmente revelado no início do mês, envolvia o uso de ferramentas da OpenAI para tarefas de cibersegurança e análise de dados no Pentágono. A notícia desencadeou um intenso debate sobre os limites éticos da IA e o papel das empresas de tecnologia em assuntos militares, levando a empresa a revisar os termos da colaboração.

O contexto desta polêmica remonta aos princípios fundadores da OpenAI, que originalmente se comprometeu a desenvolver inteligência artificial geral (IAG) de forma segura e benéfica para a humanidade, com salvaguardas explícitas contra usos que pudessem causar danos ou permitir 'armamentização autônoma'. O acordo inicial com o exército americano, embora limitado a áreas não letais, como defesa cibernética e otimização logística, foi percebido por muitos como um afastamento perigoso desses princípios. Críticos argumentaram que mesmo usos 'não letais' em um contexto militar poderiam normalizar a relação entre IA e guerra, abrindo a porta para aplicações mais controversas no futuro.

Dados relevantes indicam que os gastos do Departamento de Defesa dos EUA em IA e aprendizado de máquina cresceram exponencialmente nos últimos anos, com um orçamento solicitado de bilhões de dólares para 2024. Neste ecossistema, a OpenAI, com seus modelos de linguagem avançados como o GPT-4, representa um ativo estratégico. No entanto, a empresa manteve uma política de uso que proíbe explicitamente atividades com alto risco de dano físico, incluindo o desenvolvimento de armas. A ambiguidade do acordo militar colocou essa política sob escrutínio.

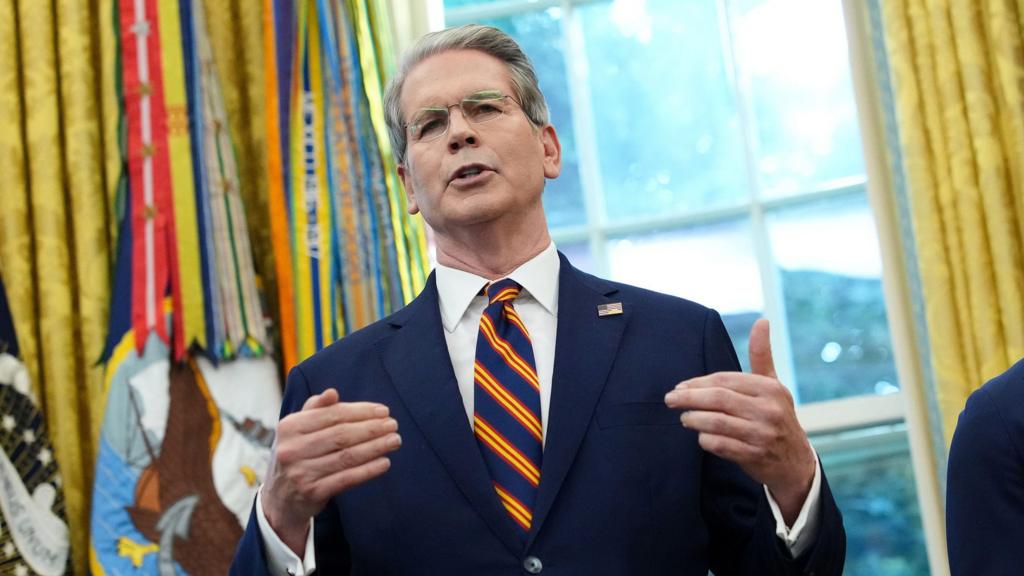

Em declarações à imprensa, um porta-voz da OpenAI afirmou: 'Ouvimos as preocupações expressas por nossa comunidade e parceiros externos. Embora acreditemos no potencial da IA para melhorar a segurança nacional em áreas como a defesa contra ciberataques, devemos garantir que qualquer colaboração se alinhe de maneira inequívoca e transparente com nosso compromisso de segurança e benefício. Por isso, revisamos o acordo para incluir limites mais rígidos, auditorias externas e uma cláusula de rescisão se qualquer desvio de nossos padrões éticos for identificado.'

O impacto desta decisão é multifacetado. Por um lado, acalma temporariamente a dissidência interna e externa, preservando a imagem da OpenAI como uma empresa com consciência ética. Por outro, levanta questões mais amplas sobre a viabilidade de manter barreiras absolutas em um setor onde a tecnologia de uso duplo (civil e militar) é a norma. Concorrentes como Google e Microsoft também enfrentaram dilemas semelhantes com projetos militares, como o controverso Projeto Maven do Google, sugerindo que este não será o último confronto entre a indústria de IA e sua consciência.

Em conclusão, a reconsideração da OpenAI sobre sua colaboração com o exército dos EUA destaca a tensão permanente entre inovação tecnológica, imperativos comerciais e responsabilidade ética. Embora a modificação do acordo represente uma vitória para os defensores de uma IA responsável, também revela a pressão constante exercida pelos grandes contratos governamentais sobre as startups de tecnologia. O episódio serve como um lembrete crucial de que, na era da IA, os marcos de governança e supervisão devem evoluir no mesmo ritmo que as capacidades técnicas, exigindo um diálogo contínuo e transparente entre empresas, governos e sociedade civil para navegar neste território inexplorado.